after 4 weeks of drying the boards on my heating, i tryed to arrange a date with doogie, who helped on the phase one. not knowing, how the pitch-wheel and the floppy was connected, the synth was just closer to be doomed. but, after 6 weeks or 7 we arranged a double day, to slowly rebuild the kurzweil from its parts.

reassembling … how to start without a manual on that level. so … isolating the parts from the case and other connected parts, was in the focus here. the power supply was also not to trust, but with a headphone, we went sure, that no noise nor sine waves came from that part, beside the expected voltage. it looked good for the moment, power was there, no cable was missing, the defect buttons were easy to change … so lets try it.

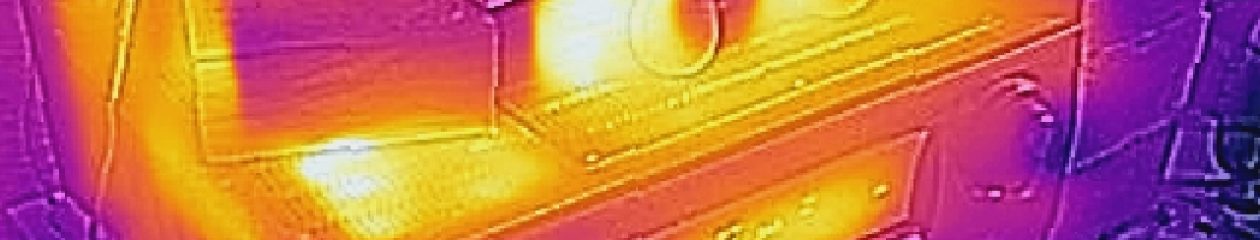

nope, nothing to see on the display, not lights on, no sound nor growling from a short cut were to hear, so we ripped all parts of the case and connected each cable to a part, that was numbered or signed in somehow. but … fail. some 2-3-4 ends of cables were without a mark. hm, …. we tried to start the engine, but one of the ribbon cables starts smoking, a sure sign of a short cut, that was not the right port for that cable. we stoped and looked on each board, not seeing the difference, we have had to made. so we started again, and the cable went hot instantly – again.

the engineers on kurzweil showed us, where the fork is hanging around. pumping current over a tiny, 0.14 mm² of cable, couldnt be more worse. they used big cables for big wattages, but why did they did that different, on the engine board then? we looked closer after some minutes, or was it hours of cluesless talkings. we suprisingly found 2 connectors without a cable, so we switched something between the sampler, i think the scanner and the engine – audio analog or digitized, anyhow, could be the case. we stoped breathing when we switched on the power plug again … and … the display starts working. but, as i estimated on old-fashioned-hardware, each part of the system needs to be connected the way it should, so we couldnt check part by part, we had to stuff all together, with the hope, its allright then.

the five knobs or buttons on the input board, which were dead as distances holder, they were quickly replaced by some from the a-z/+-# keyboard. five pieces, let one cost 50 cent, made that accident happen, that we started to enjoy then later. the system came up, the boot-cycle went successfully done and the thing came to life. but having everything upside down, not knowing what buttons to push, we tried some intuitive haptics by accident, but after everyone of us three tried it, some preset with playable pattern suprised us thru the headphones and speakers with sound. the rest was routine to not mixup the three packs of screws and as we nearly closed the parts of the case, the kdfx board went back to my mind.

i had spare parts to drop in, with more power, more harmonic distortions and bigger rooms to simulate. but first, i wanted to get warm a bit with that tier, to check, if its worth the switch from software-based production to this kind of hardware. i would notice, it is it worth, but fiddling the menue was not funny, so the vast.programmer needs to be setup … next or the very next weekend … some day. that reopening, droping in, updating the firmware with a floppy drive, then stimulating to live once again will need a long way to get warm with that idea. one nice part is, that after that years, the software is still online on kurzweils server, that is a big plus in that whole story.